A Nova Lei da Califórnia: Protegendo Crianças no Mundo dos Chatbots

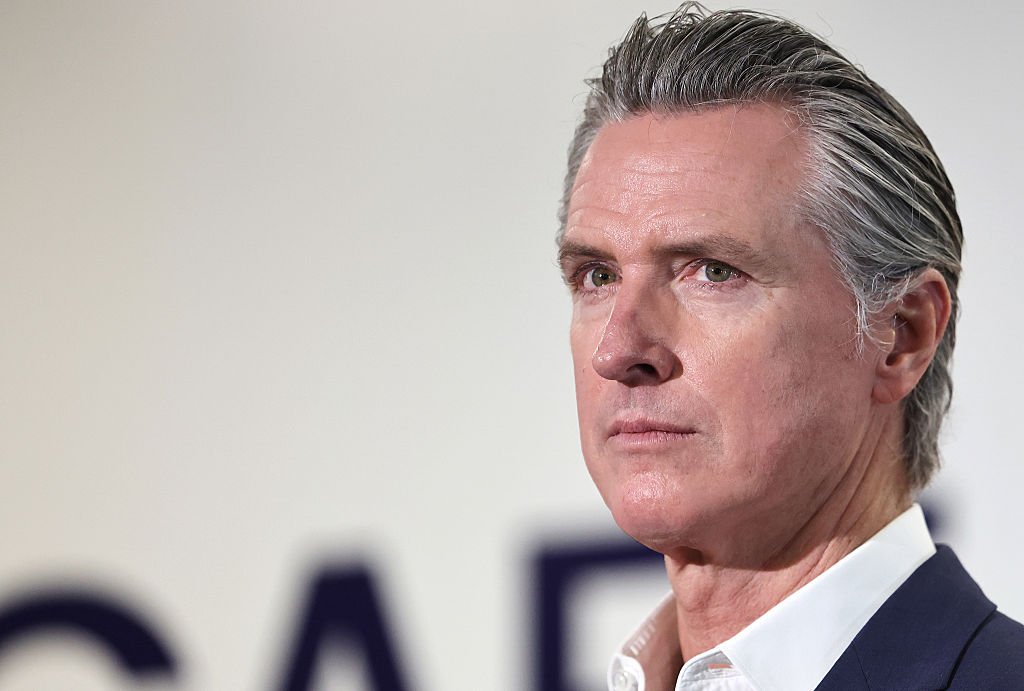

A inteligência artificial (IA) está mudando a forma como interagimos com a tecnologia, especialmente com chatbots que se tornaram populares como companheiros virtuais. No entanto, essa facilidade pode trazer riscos significativos, especialmente para crianças e adolescentes. Recentemente, a Califórnia, sob a liderança do governador Gavin Newsom, deu um passo histórico ao aprovar a lei SB 243, que regulamenta o uso de chatbots de IA, criando um marco na proteção dos jovens.

Uma Nova Esperança para a Segurança das Crianças

O projeto de lei SB 243 visa proteger crianças e usuários vulneráveis dos potenciais danos associados ao uso de chatbots residenciais. A lei exige que as empresas, desde grandes laboratórios como Meta e OpenAI até startups de IA focadas em criação de avatares, implementem protocolos de segurança robustos. Isso significa que as empresas agora têm uma responsabilidade legal se seus chatbots não atenderem aos padrões estabelecidos pela nova legislação.

O Contexto que Levou à Criação da Lei

A necessidade desta regulamentação se intensificou após eventos trágicos que chamaram a atenção para os perigos dos chatbots sem supervisão. Um exemplo marcante foi a história de Adam Raine, um adolescente que, após uma série de conversas suicidas com o ChatGPT, tirou a própria vida. Esta situação alarmante ficou mais crítica quando surgiram documentos internos que mostraram que chatbots de empresas como a Meta estavam permitindo conversas de natureza "romântica" e "sensual" com jovens. Recentemente, uma família no Colorado processou a Character AI depois que sua filha de 13 anos também cometeu suicídio, o que foi atribuído a interações problemáticas com um chatbot.

As Palavras do Governador

Gavin Newsom se posicionou fortemente sobre a importância de proteger as crianças no ambiente digital. Ele afirmou: "Tecnologias como chatbots e redes sociais podem inspirar e educar, mas, sem medidas adequadas, podem se tornar ferramentas de exploração e perigo. Não podemos ficar de braços cruzados enquanto empresas funcionam sem limites.” A mensagem é clara: a segurança das futuras gerações deve estar acima do lucro.

O Que A Lei SB 243 Estabelece?

A partir de 1º de janeiro de 2026, a SB 243 exigirá diversas medidas:

- Verificação de Idade: As empresas deverão garantir que apenas usuários apropriados tenham acesso a chatbots.

- Advertências e Transparecia: É essencial que fique claro para os usuários que as interações são geradas por IA, sem a pretensão de serem aconselhamentos clínicos.

- Protocolos de Crise: As empresas serão obrigadas a implementar estratégias para lidar com situações de suicídio ou automutilação, compartilhando dados com o Departamento de Saúde Pública do estado.

- Interações Saudáveis: As empresas deverão oferecer lembretes para as crianças sobre o uso responsável dos chatbots, além de barrar conteúdos sexualmente explícitos.

Consequências para Infratores

As penalidades para empresas que não cumprirem as normas são severas. Multas de até $250.000 podem ser aplicadas por ofensas relacionadas a deepfakes ilegais, que têm se tornado uma preocupação crescente na era digital.

Empregando Medidas de Segurança Já

Antes mesmo da implementação da lei, algumas empresas começaram a tomar medidas preventivas. A OpenAI, por exemplo, introduziu controles parentais e sistemas de detecção de autolesão para os menores que utilizam o ChatGPT. A Character AI, por sua vez, já deixou claro em suas interações que todos os diálogos são gerados por uma inteligência artificial.

Uma Tendência em Ascensão

California está liderando o caminho em termos de regulamentação de IA. Apenas algumas semanas antes da promulgação da SB 243, o governador Newsom assinou a SB 53, que estabelece requisitos de transparência para grandes empresas de IA, assegurando que suas práticas de segurança sejam conhecidas. Essa legislação também protege os denunciantes em casos de irregularidades internas.

O Que Outros Estados Estão Fazendo?

A regulamentação da IA não é exclusividade da Califórnia. Outros estados, como Illinois, Nevada e Utah, implementaram leis que restringem ou proíbem o uso de chatbots de IA como substitutos para cuidados de saúde mental licenciados. Essas ações refletem uma preocupação crescente com o uso ético da tecnologia, especialmente em áreas sensíveis como a saúde emocional de crianças e adolescentes.

O Papel das Empresas de Tecnologia

Empresas como OpenAI e Meta já estão sendo questionadas sobre como suas tecnologias impactam a vida dos usuários mais jovens. A necessidade de um diálogo aberto e de responsabilidade sobre o desenvolvimento dessas ferramentas é fundamental. À medida que a tecnologia avança, as empresas precisam se comprometer a priorizar a segurança dos usuários.

Conclusão: Uma Luta Coletiva pela Segurança

A aprovação da lei SB 243 na Califórnia é um passo crucial em direção à proteção das crianças em um mundo cada vez mais digital e complexo. É um lembrete de que, enquanto as tecnologias podem trazer benefícios, também é responsabilidade da sociedade criar estruturas que garantam segurança e apoio. A luta pela proteção dos jovens está apenas começando, mas com iniciativas como essa, podemos avançar em direção a um futuro mais seguro e responsável. Vamos continuar essa conversa, porque a segurança das crianças não deve ser uma questão de debate, mas uma prioridade universal.